在过去的三十年里,我们消费音乐的方式已经完全改变。随着 DSP 或数字流媒体服务(如 Spotify 和 Apple Music)的出现,音频规范化已成为这一过程的重要组成部分。

但音频正常化是什么意思?如何对自己的数字音频文件进行规范化处理?下面,我们将分享如何对音频进行规范化处理,以及为什么这是现代音乐创作的关键步骤。

什么是音频正常化?

对音频进行归一化处理时,需要对数字音频文件施加一定的增益。这将使音频文件达到目标的感知振幅或音量水平,同时保留音轨的动态范围。

音频正常化用于从选定的音频片段中获得最大音量。它还可用于在多个音频片段中创建更多的一致性。例如,在一张专辑或 EP 中可能有多个音轨。

值得注意的是,动态范围较大的歌曲可能更难进行有效的归一化处理。例如,峰值振幅可能会在归一化过程中被压扁或失真。

因此,在进行音频正常化处理时,每个音频片段的处理方法都不尽相同。音频正常化对任何数字录音都至关重要,但并没有放之四海而皆准的方法。

为什么要对音频进行归一化处理?

那么,为什么要对音频文件进行归一化处理呢?以下是必须进行响度归一化处理的几种情况:

为流媒体服务做准备

流媒体服务为其音乐库中的歌曲设置了标准的正常化音量。这样,听众从一首歌切换到另一首歌时,就不必大幅调高或调低音量。每个平台都有不同的目标音量,因此在不同的流媒体平台上使用不同的母带也是常有的事。

最受欢迎的流媒体服务的LUFs 响度目标如下:

Spotify:-14 LUFS

苹果音乐:-16 LUFS

亚马逊音乐:-9 至 -13 LUFS

Youtube:-13至-15 LUFS

Deezer:-14 至 -16 LUFS

CD:-9 LUFS

声音云:-8 至 -13 LUFS

在确定每个母版的目标级别时,每位工程师都有自己的理念,但这些标准都应考虑在内。

实现最大容量

音频正常化可用于实现每个音频文件的最大增益。这在将音轨导入音频编辑软件或提高单个音频文件音量时非常有用。

在多个音频文件之间创建一致的电平

您还可以对音频进行归一化处理,将多个音频文件设置为相同的相对电平。这在增益分级等流程中尤为重要,在这些流程中,您需要设置音频电平,为下一阶段的处理做准备。

在完成一个音乐项目(如专辑或 EP)后,您还可能对音频文件进行规范化处理和编辑。整个录音的氛围和音效应保持一致,因此您可能需要回头调整所有歌曲的增益。

音频标准化的两种类型

针对不同的录音使用情况,有不同类型的音频归一化。大多数情况下,音频归一化可归结为峰值归一化和响度归一化。

峰值标准化

峰值归一化是一个线性过程,在音频信号中应用相同的增益量,以产生与音轨峰值振幅一致的电平。动态范围保持不变,新的音频文件听起来或多或少都是一样的,音轨不会转变成更响亮或更安静的音频文件。

此过程可找到音频文件的最高 PCM 值或脉冲编码调制值。基本上,峰值归一化是根据数字音频系统的上限来处理音频的,通常相当于将最大峰值归一化为 0 DBs。

通过峰值归一化实现的归一化效果严格基于峰值电平,而不是音轨的感知音量。

响度标准化

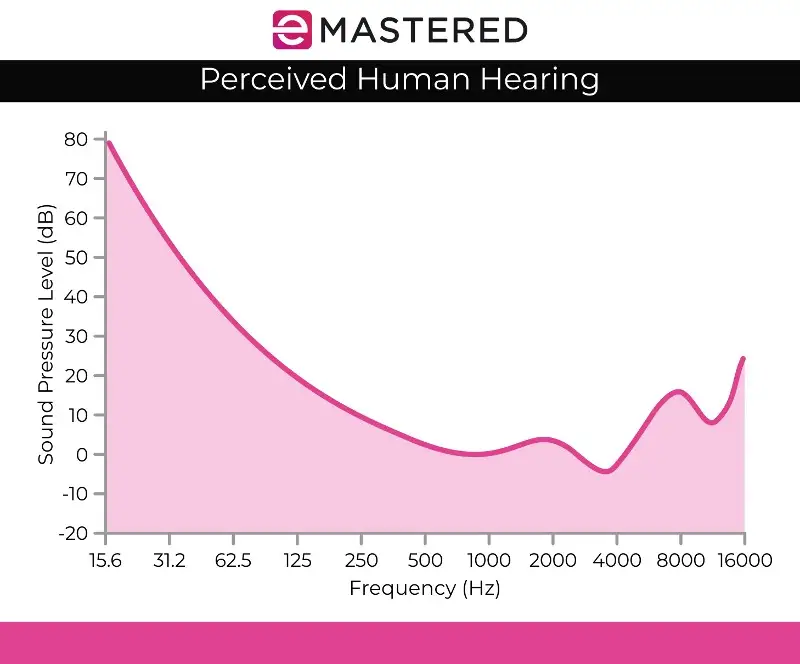

响度归一化过程更为复杂,因为它考虑到了人的听觉感知。由于人耳在感知方面存在一定的主观缺陷,因此人类听觉会分别考虑不同的音量和振幅。您可能会听到这种处理过程被称为 EBU R 128 音量检测。

例如,以相同音量持续播放的声音与瞬时或短暂播放的声音听起来会自动变大。您可以以相同的音量发出这些声音,但人的听觉仍会认为持续的声音更响亮。因此,响度归一化必须考虑这些感知偏移。

有些人还认为,大音量的音乐往往更好听。在流媒体服务出现之前,这就是响度大战的起因,音乐家们会试图最大限度地提高峰值音量,以制作出音质更悦耳的艺术作品。值得庆幸的是,音频正常化有效地终结了音量大战,这样当你从一个音轨跳到下一个音轨时,就不会经常听到不同的音量了。

响度归一化是以 LUF 为单位进行测量的,这更符合人耳的真实感受,也是电影、电视、广播和流媒体服务等应用中的音频标准。与峰值归一化一样,0 分贝仍然是标准。

如上图所示,Fletcher Munson 曲线可以帮助描述 LUFS 响度归一化所考虑的差异。

有效值音量检测

如果您不打算使用峰值电平归一化对立体声通道进行归一化处理,那么您很可能会使用响度归一化,但还是值得一提响度处理的另一种方法,即 RMS 音量检测。

归一化过程类似于 LUF 的响度归一化,但它使用的是均方根电平。均方根或 RMS 测量一段或整个片段的平均音量。

然而,就像根据最高峰值进行归一化一样,RMS 归一化并不考虑人耳的听觉。这就是母带制作工程师通常使用 LUF 响度单位和归一化流程作为标准的原因。母带制作不仅仅是在整个项目中创建匹配的音量。退一步考虑动态、人的感知以及每个音轨之间的平衡也很关键。

规范化与压缩:有什么区别?

很多时候,正常化和压缩被认为是一回事,但这是一个常见的误解。压缩的目的是提高音轨的最低音量,降低音轨的最高音量,从而使音轨的整体音量更加一致。与此相反,归一化则是将最响亮的设置点设置为音轨的上限。

在此基础上,按比例对音频的其他部分进行剪辑增益,保留动态效果(最响亮声音和最柔和声音之间的距离),根据峰值电平有效地提高感知音量。

音频标准化的缺点

值得注意的是,音频正常化也有一些缺点。大多数情况下,你只能在创作过程的最后阶段对音频进行归一化处理。这是因为归一化通常会使音频达到数字上限内的峰值振幅,因此在一段音频归一化后,你就没有太多的编辑能力了。

你不会想对仍需在多轨录音中进行混音的单个音轨进行归一化处理。如果所有单独音轨都已归一化到数字音频上限,那么在一起播放时肯定会出现剪切。

音频正常化在本质上也具有破坏性。当你对音频进行归一化处理时,数字处理就已经融入音轨之中。因此,音频正常化有明确的时间和地点。这一过程主要是在音频文件经过调音处理后使用。

如何使音频正常化

每个 DAW 都有自己的数字音频归一化方法。我们将展示如何在 Ableton Live 中对音频进行归一化处理,但所有音频编辑软件的控件中都有这种功能:

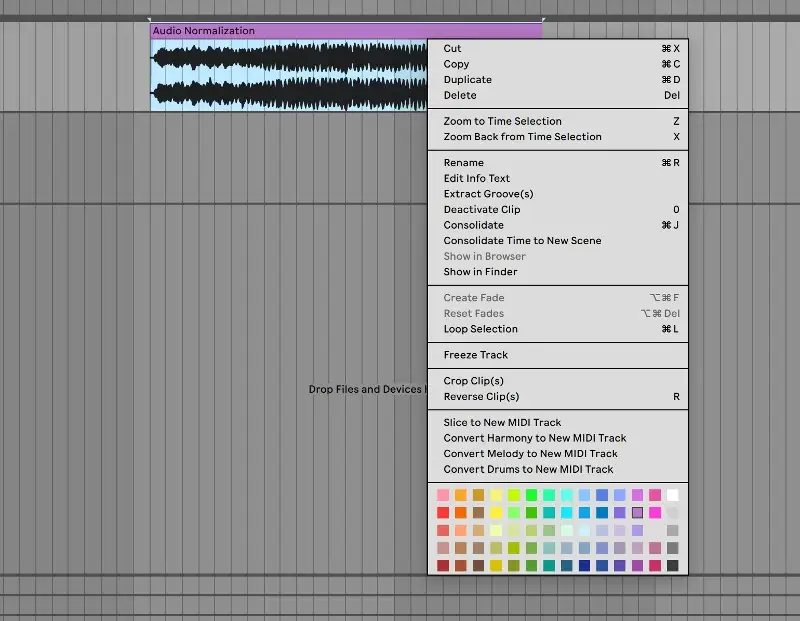

1.合并轨道

首先,将音频文件导入一个干净的音轨。选择音轨,右击并在菜单上选择 "合并"。您也可以使用键盘快捷键 CTRL/CMND + J 快速合并突出显示的音轨。

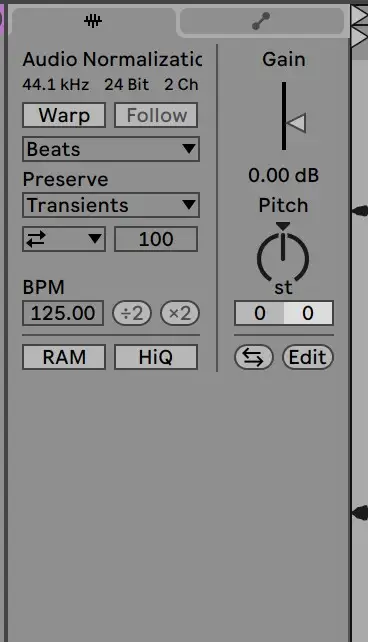

2.禁用翘曲并将增益重置为 0 dB

然后,转到采样片段禁用 warp 并将增益重置为 0 DB。您可以双击增益箭头来做到这一点:

3.与原始文件核对

从这里开始,您的片段就应该正常化了!您可以对照原始音频文件检查片段的电平,确保处理正确无误。

音频归一化是任何制作人都必须掌握的一项基本技能。希望本指南能让您更容易理解如何对音轨进行归一化处理以及这一过程的重要性。