I løbet af de sidste tre årtier har virkeligheden for, hvordan vi forbruger musik, ændret sig fuldstændigt. Med fremkomsten af DSP'er eller digitale streamingtjenester som Spotify og Apple Music er lydnormalisering blevet en vigtig del af processen.

Men hvad vil det sige at normalisere lyd? Og hvordan kan du normalisere dine egne digitale lydfiler? Nedenfor fortæller vi præcis, hvordan man normaliserer lyd, og hvorfor det er et vigtigt skridt i moderne musikproduktion.

Hvad er lydnormalisering?

Når du normaliserer lyd, tilfører du en vis mængde forstærkning til en digital lydfil. Det bringer din lydfil op på et ønsket niveau for opfattet amplitude eller lydstyrke, samtidig med at sporets dynamiske område bevares.

Lydnormalisering bruges til at opnå den maksimale lydstyrke fra et valgt lydklip. Det kan også bruges til at skabe mere konsistens på tværs af flere lydklip. Du kan f.eks. have flere spor i et album eller en EP.

Det er værd at bemærke, at sange med et større dynamisk område kan være mere udfordrende at normalisere effektivt. For eksempel kan en spidsamplitude blive mast eller forvrænget gennem normaliseringsprocessen.

Derfor skal hvert enkelt lydklip behandles forskelligt, når det drejer sig om normaliseringsprocessen. Lydnormalisering er afgørende for enhver digital optagelse, men der findes ikke en fremgangsmåde, der passer til alle.

Hvorfor skal du normalisere lyd?

Så hvorfor er det vigtigt at normalisere dine lydfiler? Her er et par scenarier, hvor loudness-normalisering er et must:

Forberedelse til streamingtjenester

Streamingtjenester indstiller et standardiseret normaliseringsniveau på tværs af sange i deres musikbiblioteker. På den måde behøver lytterne ikke at skrue drastisk op eller ned for lyden, når de skifter fra en sang til en anden. Hver platform har et forskelligt målniveau, så det er ikke ualmindeligt at have forskellige mastere til forskellige streamingplatforme.

LUF's Loudness-mål for de mest populære streamingtjenester er som følger:

Spotify: -14 LUFS

Apple Music: -16 LUFS

Amazon Music: -9 til -13 LUFS

Youtube: -13 til -15 LUFS

Deezer: -14 til -16 LUFS

CD: -9 LUFS

Soundcloud: -8 til -13 LUFS

Hver ingeniør har sin egen filosofi, når det gælder om at bestemme målniveauet for hver master, men disse standardiseringer bør tages i betragtning.

Opnåelse af maksimal volumen

Lydnormalisering kan bruges til at opnå den maksimale forstærkning af hver lydfil. Dette kan være utroligt nyttigt, når man importerer spor til lydredigeringssoftware eller for at gøre en individuel lydfil højere.

Skab et ensartet niveau mellem flere lydfiler

Du kan også normalisere lyd for at indstille flere lydfiler på samme relative niveau. Det er især vigtigt i processer som gain staging, hvor man indstiller lydniveauer som forberedelse til næste trin i behandlingen.

Du kan også normalisere og redigere lydfiler, når du er færdig med et musikprojekt som et album eller en EP. Hele indspilningsatmosfæren og lyden skal være nogenlunde ensartet hele vejen igennem, så du skal måske gå tilbage og justere gain i forbindelse med alle sange.

De to typer af lydnormalisering

Der findes forskellige typer lydnormalisering til forskellige anvendelser af lydoptagelser. Det meste af tiden kan normalisering af lyd koges ned til peak-normalisering og loudness-normalisering.

Normalisering af spidsbelastning

Peak-normalisering er en lineær proces, hvor den samme mængde forstærkning anvendes på tværs af et lydsignal for at skabe et niveau, der stemmer overens med lydsporets peak-amplitude. Det dynamiske område forbliver det samme, og den nye lydfil lyder mere eller mindre ens, bortset fra at sporet forvandles til en mere højlydt eller stille lydfil.

Denne proces finder den højeste PCM-værdi eller pulskodemodulationsværdi i en lydfil. Dybest set behandler peak-normaliseringen lyd baseret på den øvre grænse for et digitalt lydsystem, hvilket normalt svarer til at normalisere max peak ved 0 DBs.

Normaliseringseffekten gennem peak-normalisering er udelukkende baseret på peak-niveauer, snarere end den opfattede lydstyrke i sporet.

Normalisering af lydstyrke

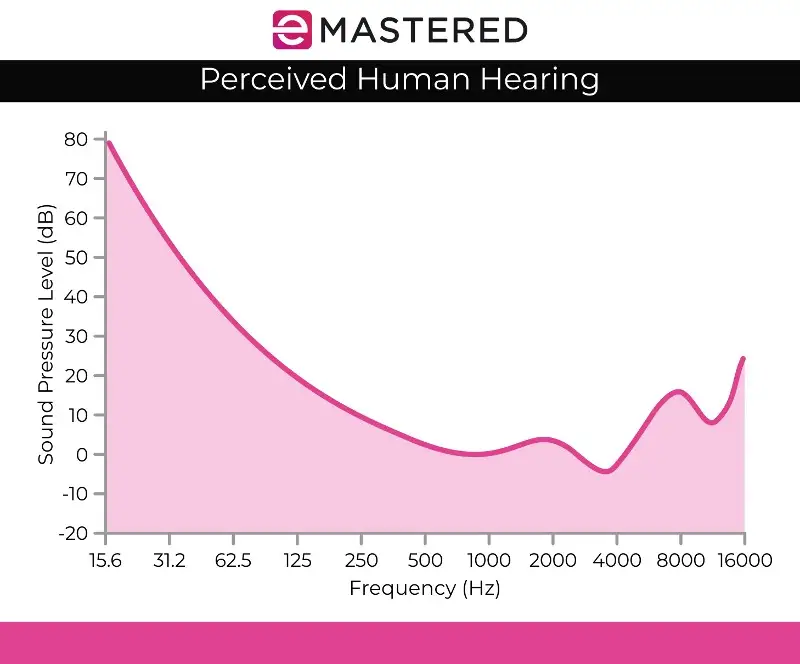

Normaliseringsprocessen for lydstyrke er mere kompleks, da den tager højde for den menneskelige høreopfattelse. Den menneskelige hørelse tager højde for forskellige lydstyrker og amplituder hver for sig, da det menneskelige øre har visse subjektive fejl, når det gælder opfattelsen. Du vil måske høre denne behandling omtalt som EBU R 128 volumenregistrering.

For eksempel lyder lyde, der er vedvarende på samme lydniveau som lyde, der afspilles kortvarigt, automatisk højere. Man kan udsende disse lyde med samme lydstyrke, og den menneskelige hørelse vil stadig opfatte den vedvarende lyd som højere. Derfor skal loudness-normalisering tage højde for disse perceptuelle forskydninger.

Nogle mener også, at højere musik har en tendens til at lyde bedre. Det var det, der gav anledning til loudness-krigen, før streamingtjenesterne eksisterede, hvor musikere forsøgte at maksimere lydstyrken for at producere et mere lydmæssigt behageligt kunstværk. Heldigvis har lydnormalisering effektivt afsluttet krigen om lydstyrke, så du ikke konstant hører forskellige lydstyrker, når du springer fra et nummer til det næste.

Loudness-normalisering måles i LUF'er, som er mere tro mod det menneskelige øre og fungerer som lydstandarder i applikationer som film, tv, radio og streamingtjenester. Ligesom ved peak-normalisering forbliver 0 dB standarden.

Fletcher Munson-kurven, som vist ovenfor, kan hjælpe med at beskrive de uoverensstemmelser, der tages højde for med LUFS' lydstyrkenormalisering.

Registrering af RMS-volumen

Hvis du ikke vil normalisere stereokanaler med spidsniveau-normalisering, vil du sandsynligvis bruge loudness-normalisering, men det er stadig værd at nævne den anden metode til loudness-behandling, som er RMS-lydstyrkeregistrering.

Normaliseringsprocessen ligner LUF's loudness-normalisering, men den bruger RMS-niveauer i stedet. Root Mean Square eller RMS måler den gennemsnitlige lydstyrke for en sektion eller hele varigheden af et klip.

Men ligesom normalisering baseret på den højeste peak tager RMS-normalisering ikke højde for den menneskelige hørelse. Derfor arbejder mastering-ingeniører typisk med LUF's loudness-enheder og normaliseringsprocesser som standard. Mastering handler ikke kun om at skabe matchende lydstyrker i hele projektet. Det er også vigtigt at træde et skridt tilbage og overveje dynamik, menneskelig opfattelse og balance mellem hvert enkelt spor.

Normalisering og komprimering: Hvad er forskellen?

Mange gange tror man, at normalisering og komprimering er det samme, men det er en almindelig misforståelse. Komprimering er designet til at hæve den laveste lydstyrke i et spor og sænke spidserne i et spor, hvilket skaber et mere ensartet lydniveau. I modsætning hertil indstiller normalisering det højeste sætpunkt som loftet i dit lydspor.

Derfra tilføres resten af lyden en forholdsmæssig mængde clip gain, som bevarer dynamikken (afstanden mellem de højeste og laveste lyde), hvilket effektivt øger den opfattede lydstyrke afhængigt af spidsniveauet.

Ulemperne ved lydnormalisering

Det er værd at bemærke, at der er nogle ulemper ved lydnormalisering. Det meste af tiden normaliserer du kun lyd i de sidste faser af skabelsesprocessen. Det skyldes, at normalisering ofte bringer lyden op til den maksimale amplitude inden for et digitalt loft, så du har ikke mange redigeringsmuligheder, efter at et stykke lyd er blevet normaliseret.

Du ønsker ikke at normalisere individuelle lydspor, som stadig skal mixes i forbindelse med en flersporsoptagelse. Hvis alle individuelle komponenter allerede er normaliseret til dit digitale lydloft, vil de helt sikkert klippe, når de afspilles sammen.

Lydnormalisering er også destruktiv af natur. Når du normaliserer lyd, bliver den digitale behandling bagt ind i lydsporet. Derfor har lydnormalisering en klar tid og et klart sted. Denne proces bruges for det meste, når dine lydfiler er blevet behandlet efter smag og behag.

Sådan normaliserer du lyd

Hver DAW har sin egen måde at normalisere digital lyd på. Vi viser, hvordan du kan normalisere lyd i Ableton Live, men al lydredigeringssoftware har denne mulighed indbygget i sine kontroller:

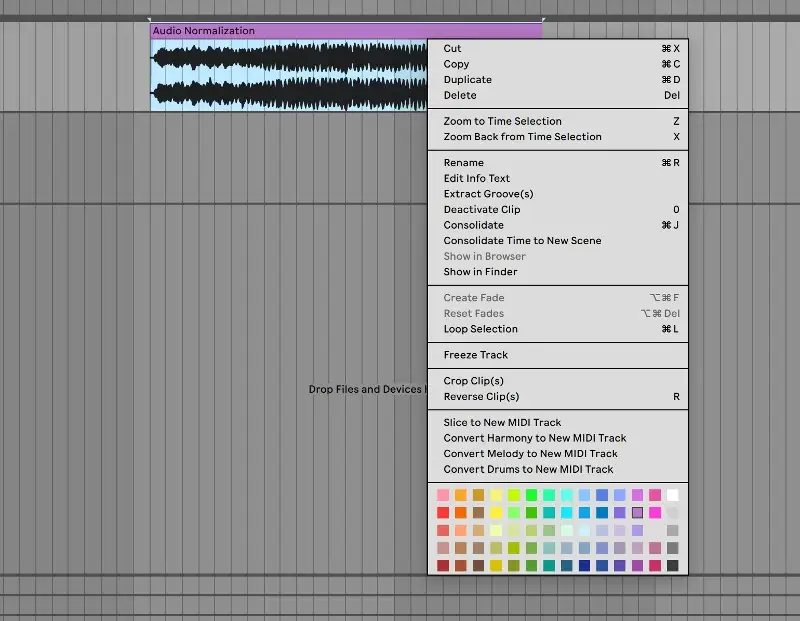

1. Konsolider dit spor

Til at begynde med skal du bringe din lydfil til et rent lydspor. Vælg lydsporet, højreklik og vælg "konsolider" i menuen. Du kan også bruge tastaturgenvejen CTRL/CMND + J til hurtigt at konsolidere et markeret spor.

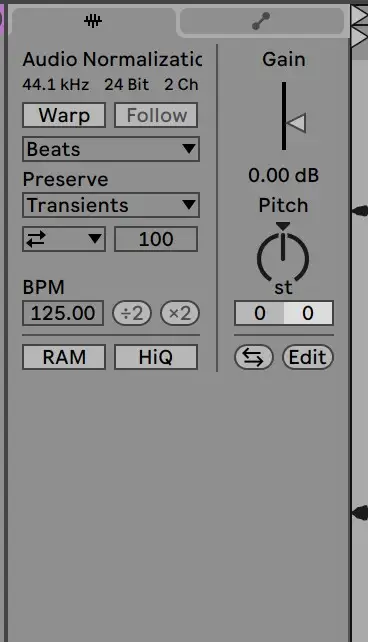

2. Deaktiver Warp og nulstil Gain til 0 dB

Derfra skal du gå til prøveklippet for at deaktivere warp og nulstille gain til 0 DB. Det kan du gøre ved at dobbeltklikke på gain-pilen:

3. Tjek mod den originale fil

Herefter burde dit klip være normaliseret! Du kan tjekke dit klips niveauer i forhold til den oprindelige lydfil for at sikre dig, at det er blevet behandlet korrekt.

Normalisering af lyd er en vigtig færdighed for enhver producer. Forhåbentlig gør denne guide det lettere for dig at forstå præcis, hvordan du normaliserer dine spor, og hvor vigtig denne proces er.