I løpet av de siste tre tiårene har virkeligheten for hvordan vi konsumerer musikk endret seg fullstendig. Med inntoget av DSP-er og digitale strømmetjenester som Spotify og Apple Music har normalisering av lyd blitt en viktig del av prosessen.

Men hva betyr det å normalisere lyd? Og hvordan kan du normalisere dine egne digitale lydfiler? Nedenfor forteller vi deg nøyaktig hvordan du normaliserer lyd, og hvorfor det er et viktig steg i moderne musikkproduksjon.

Hva er lydnormalisering?

Når du normaliserer lyd, tilfører du en viss mengde forsterkning til en digital lydfil. Dette bringer lydfilen til et ønsket oppfattet amplitude- eller volumnivå, samtidig som sporets dynamiske omfang bevares.

Lydnormalisering brukes til å oppnå maksimalt volum fra et valgt lydklipp. Det kan også brukes til å skape mer konsistens på tvers av flere lydklipp. Du kan for eksempel ha flere spor i et album eller en EP.

Det er verdt å merke seg at sanger med et større dynamisk område kan være mer utfordrende å normalisere effektivt. For eksempel kan en toppamplitude bli knust eller forvrengt gjennom normaliseringsprosessen.

Derfor bør hvert enkelt lydklipp behandles forskjellig når det gjelder normaliseringsprosessen. Lydnormalisering er avgjørende for alle digitale opptak, men det finnes ikke én fremgangsmåte som passer for alle.

Hvorfor bør du normalisere lyd?

Så hvorfor er det viktig å normalisere lydfilene dine? Her er noen scenarier der normalisering av lydstyrken er et must:

Forberedelse for strømmetjenester

Strømmetjenestene setter et standard normaliseringsnivå på tvers av sangene i musikkbibliotekene sine. På denne måten slipper lytterne å skru volumet drastisk opp eller ned når de bytter fra én sang til en annen. Hver plattform har sitt eget målnivå, så det er ikke uvanlig å ha forskjellige mastere for ulike strømmeplattformer.

LUFs Loudness-målene for de mest populære strømmetjenestene er som følger:

Spotify: -14 LUFS

Apple Music: -16 LUFS

Amazon Music: -9 til -13 LUFS

Youtube: -13 til -15 LUFS

Deezer: -14 til -16 LUFS

CD: -9 LUFS

Soundcloud: -8 til -13 LUFS

Hver ingeniør har sin egen filosofi når det gjelder å bestemme målnivået for hver master, men disse standardiseringene bør tas med i betraktningen.

Oppnå maksimalt volum

Lydnormalisering kan brukes til å oppnå maksimal forsterkning av hver lydfil. Dette kan være svært nyttig når du importerer spor til et lydredigeringsprogram eller for å gjøre en enkelt lydfil høyere.

Skap et konsistent nivå mellom flere lydfiler

Du kan også normalisere lyd for å sette flere lydfiler på samme relative nivå. Dette er spesielt viktig i prosesser som gain staging, der du stiller inn lydnivåer som forberedelse til neste trinn i prosesseringen.

Du kan også normalisere og redigere lydfiler når du er ferdig med et musikkprosjekt, for eksempel et album eller en EP. Hele innspillingens atmosfære og lydbilde bør være ganske konsistent gjennom hele prosjektet, så det kan hende du må gå tilbake og justere gain for alle sangene.

De to typene lydnormalisering

Det finnes forskjellige typer lydnormalisering for ulike bruksområder for lydopptak. For det meste koker normalisering av lyd ned til normalisering av peak og loudness.

Normalisering av topper

Toppnormalisering er en lineær prosess der samme mengde forsterkning brukes på tvers av et lydsignal for å skape et nivå som samsvarer med lydsporets toppamplitude. Det dynamiske området forblir det samme, og den nye lydfilen høres mer eller mindre lik ut, bortsett fra at sporet forvandles til en mer høylytt eller lavmælt lydfil.

Denne prosessen finner den høyeste PCM-verdien eller pulskodemodulasjonsverdien i en lydfil. I utgangspunktet behandler peak-normaliseringen lyd basert på den øvre grensen for et digitalt lydsystem, noe som vanligvis tilsvarer normalisering av maks peak ved 0 DBs.

Normaliseringseffekten ved hjelp av peak-normalisering er strengt tatt basert på peak-nivåer, i stedet for det opplevde volumet i sporet.

Normalisering av lydstyrke

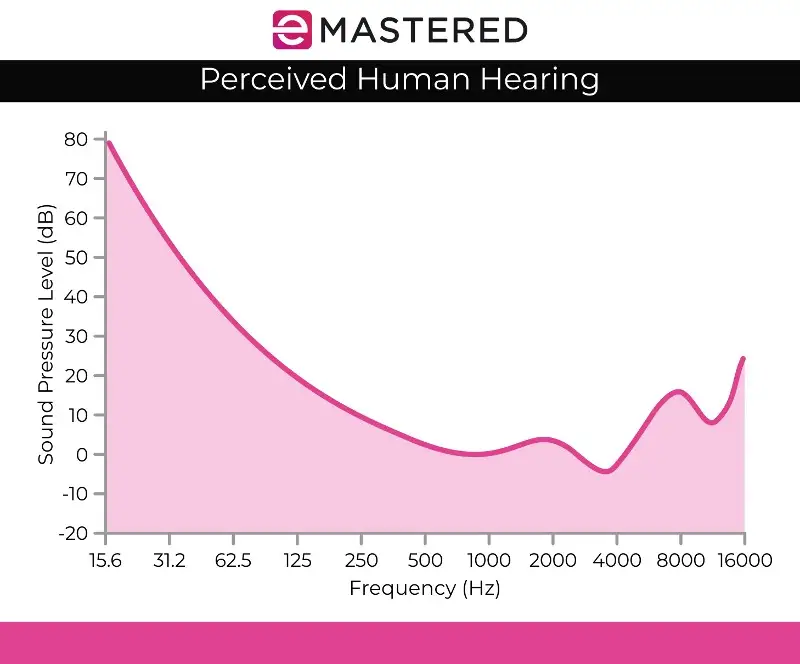

Normaliseringsprosessen for lydstyrke er mer kompleks siden den tar hensyn til den menneskelige hørselsoppfatningen. Den menneskelige hørselen tar hensyn til ulike volum og amplitude separat, siden det menneskelige øret har visse subjektive svakheter når det gjelder oppfattelse. Du vil kanskje høre denne behandlingen omtalt som EBU R 128-volumdeteksjon.

For eksempel vil lyder som holdes på samme lydnivå som lyder som spilles kortvarig eller kortvarig, automatisk høres høyere ut. Du kan sende ut disse lydene på samme volumnivå, og den menneskelige hørselen vil likevel oppfatte den vedvarende lyden som høyere. Derfor må normalisering av lydstyrke ta hensyn til disse perseptuelle forskyvningene.

Noen mener også at høyere musikk har en tendens til å høres bedre ut. Det var dette som ga opphav til loudness-krigen før strømmetjenestene eksisterte, der musikere prøvde å maksimere toppvolumet for å produsere et mer lydmessig tiltalende kunstverk. Heldigvis har lydnormalisering effektivt satt en stopper for denne krigen, slik at du ikke hele tiden hører forskjellige volum når du hopper fra ett spor til det neste.

Loudness-normalisering måles i LUF, som er mer tro mot det menneskelige øret og fungerer som lydstandarder i bruksområder som film, TV, radio og strømmetjenester. Akkurat som ved normalisering av topper er 0 dB fortsatt standard.

Fletcher Munson-kurven, som vist ovenfor, kan bidra til å beskrive avvikene som LUFS normalisering av lydstyrke tar hensyn til.

Deteksjon av RMS-volum

Hvis du ikke skal normalisere stereokanaler med normalisering av toppnivå, vil du sannsynligvis bruke loudness-normalisering, men det er likevel verdt å nevne den andre metoden for loudness-prosessering, som er RMS-volumdeteksjon.

Normaliseringsprosessen ligner på LUFs loudness-normalisering, men den bruker RMS-nivåer i stedet. Root Mean Square eller RMS måler gjennomsnittsvolumet for en seksjon eller hele varigheten av et klipp.

Men akkurat som normalisering basert på den høyeste toppen, tar ikke RMS-normalisering hensyn til den menneskelige hørsel. Dette er grunnen til at masteringteknikere vanligvis jobber med LUFs loudness-enheter og normaliseringsprosesser som standard. Mastering handler ikke bare om å skape matchende volumer gjennom hele prosjektet. Det er også viktig å ta et skritt tilbake og ta hensyn til dynamikk, menneskelig persepsjon og balanse mellom hvert enkelt spor.

Normalisering kontra komprimering: Hva er forskjellen?

Mange tror at normalisering og komprimering er det samme, men dette er en vanlig misforståelse. Komprimering er utformet for å få opp det laveste volumet i et spor og senke toppene i et spor, noe som skaper mer konsistente volumnivåer. Normalisering derimot setter det høyeste settpunktet som taket i lydsporet.

Deretter påføres resten av lyden en proporsjonal mengde klippforsterkning, slik at dynamikken (avstanden mellom de høyeste og de laveste lydene) bevares og det opplevde volumet økes avhengig av toppnivået.

Ulempene med lydnormalisering

Det er verdt å merke seg at det finnes noen ulemper med lydnormalisering. Som oftest normaliserer du bare lyden i sluttfasen av produksjonsprosessen. Dette skyldes at normalisering ofte bringer lyden opp til toppamplituden innenfor et digitalt tak, slik at du ikke har så mange redigeringsmuligheter etter at et lydstykke er normalisert.

Du ønsker ikke å normalisere individuelle lydspor som fortsatt må mikses i forbindelse med et flersporsopptak. Hvis alle enkeltkomponentene allerede er normalisert til det digitale lydtaket, kommer de helt sikkert til å klippe når de spilles av sammen.

Lydnormalisering er også destruktivt av natur. Når du normaliserer lyd, bakes den digitale behandlingen inn i lydsporet. Derfor har lydnormalisering en klar tid og et klart sted. Denne prosessen brukes for det meste etter at lydfilene har blitt behandlet etter smak og behag.

Slik normaliserer du lyd

Hver DAW har sin egen måte å normalisere digital lyd på. Vi viser hvordan du kan normalisere lyd i Ableton Live, men alle lydredigeringsprogrammer har denne funksjonen innebygd i kontrollene:

1. Konsolider sporene dine

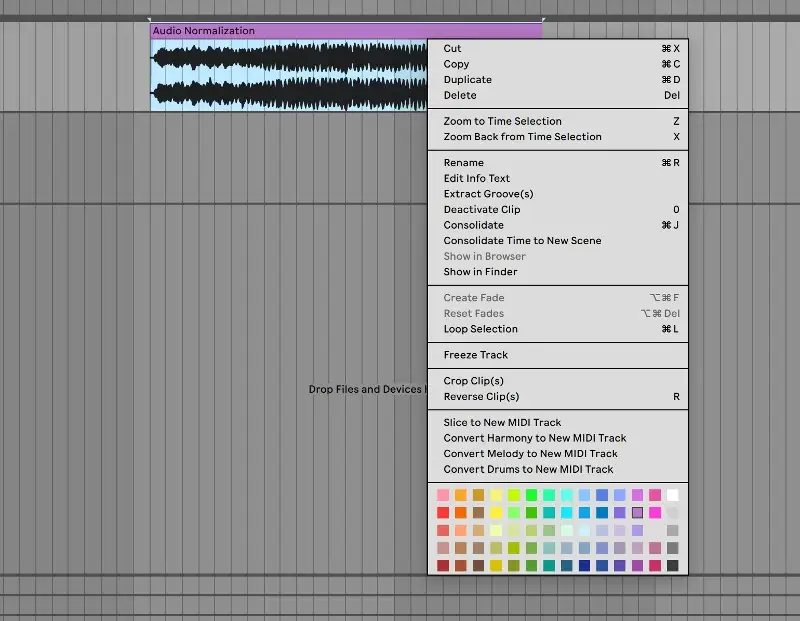

Du begynner med å hente lydfilen til et rent lydspor. Velg lydsporet, høyreklikk og velg "konsolider" på menyen. Du kan også bruke hurtigtasten CTRL/CMND + J for å raskt konsolidere et uthevet spor.

2. Deaktiver Warp og tilbakestill forsterkning til 0 dB

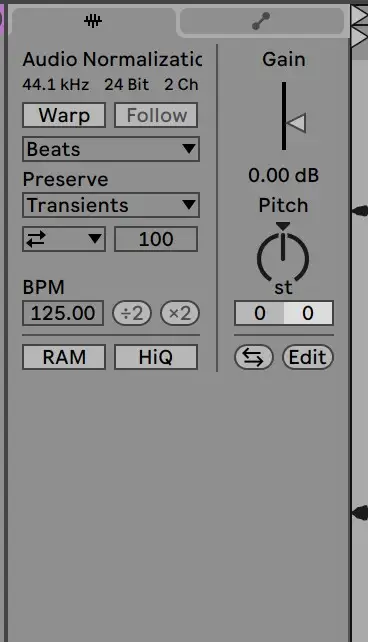

Gå deretter til eksempelklippet for å deaktivere warp og tilbakestille gain til 0 DB. Du kan gjøre dette ved å dobbeltklikke på gain-pilen:

3. Sjekk mot den opprinnelige filen

Deretter skal klippet ditt være normalisert! Du kan sjekke klippets nivåer mot den opprinnelige lydfilen for å forsikre deg om at det ble behandlet riktig.

Normalisering av lyd er en viktig ferdighet for enhver produsent. Forhåpentligvis gjør denne guiden det lettere for deg å forstå nøyaktig hvordan du normaliserer sporene dine og hvor viktig denne prosessen er.