Au cours des trois dernières décennies, la réalité de la consommation de la musique a complètement changé. Avec l'avènement des DSP ou des services de streaming numérique comme Spotify et Apple Music, la normalisation audio est devenue un élément essentiel du processus.

Mais qu'est-ce que la normalisation audio ? Et comment pouvez-vous normaliser vos propres fichiers audio numériques ? Nous vous expliquons ci-dessous comment normaliser l'audio et pourquoi il s'agit d'une étape clé de la création musicale moderne.

Qu'est-ce que la normalisation audio ?

Lorsque vous normalisez de l'audio, vous appliquez une certaine quantité de gain à un fichier audio numérique. Cela permet d'amener votre fichier audio à un niveau cible d'amplitude ou de volume perçu, tout en préservant la plage dynamique des pistes.

La normalisation audio est utilisée pour obtenir le volume maximum d'un clip audio sélectionné. Elle peut également être utilisée pour créer une plus grande cohérence entre plusieurs clips audio. Par exemple, vous pouvez avoir plusieurs pistes dans un album ou un EP.

Il convient de noter qu'il peut être plus difficile de normaliser efficacement les morceaux dont la plage dynamique est plus large. Par exemple, un pic d'amplitude peut être écrasé ou déformé par le processus de normalisation.

Par conséquent, chaque clip audio doit être abordé différemment en ce qui concerne le processus de normalisation. La normalisation audio est essentielle pour tout enregistrement numérique, mais il n'existe pas d'approche unique.

Pourquoi normaliser l'audio ?

Pourquoi est-il important de normaliser vos fichiers audio ? Voici quelques scénarios dans lesquels la normalisation du volume sonore est indispensable :

Préparation aux services de diffusion en continu

Les services de diffusion en continu fixent un niveau de normalisation standard pour les chansons hébergées dans leurs bibliothèques musicales. Ainsi, les auditeurs n'auront pas à augmenter ou à diminuer radicalement le volume lorsqu'ils passeront d'une chanson à l'autre. Chaque plateforme ayant un niveau cible différent, il n'est pas rare d'avoir des masters différents pour les différentes plateformes de streaming.

Les cibles de sonorité LUFs pour les services de streaming les plus populaires sont les suivantes :

Spotify : -14 LUFS

Apple Music : -16 LUFS

Amazon Music : -9 à -13 LUFS

Youtube : -13 à -15 LUFS

Deezer : -14 à -16 LUFS

CD : -9 LUFS

Soundcloud : -8 à -13 LUFS

Chaque ingénieur a sa propre philosophie lorsqu'il s'agit de déterminer le niveau cible pour chaque master, mais ces normalisations doivent être prises en compte.

Atteindre un volume maximal

La normalisation audio peut être utilisée pour obtenir le gain maximal de chaque fichier audio. Cela peut s'avérer extrêmement utile lors de l'importation de pistes dans un logiciel d'édition audio ou pour augmenter le volume d'un fichier audio individuel.

Créer un niveau cohérent entre plusieurs fichiers audio

Vous pouvez également normaliser l'audio pour placer plusieurs fichiers audio au même niveau relatif. Cette fonction est particulièrement essentielle dans des processus tels que la mise en scène du gain, où vous définissez les niveaux audio en préparation de l'étape suivante du traitement.

Vous pouvez également normaliser et éditer des fichiers audio à l'issue d'un projet musical tel qu'un album ou un EP. L'atmosphère et le son de l'enregistrement doivent être relativement cohérents d'un bout à l'autre, de sorte qu'il vous faudra peut-être revenir en arrière et ajuster le gain dans le contexte de toutes les chansons.

Les deux types de normalisation audio

Il existe différents types de normalisation audio pour divers cas d'utilisation de l'enregistrement audio. La plupart du temps, la normalisation audio se résume à la normalisation des crêtes et à la normalisation de l'intensité sonore.

Normalisation des pics

La normalisation des crêtes est un processus linéaire dans lequel la même quantité de gain est appliquée à un signal audio pour créer un niveau cohérent avec l'amplitude de crête de la piste audio. La plage dynamique reste la même et le nouveau fichier audio sonne plus ou moins de la même manière, sauf si la piste se transforme en un fichier audio plus fort ou plus silencieux.

Ce processus trouve la valeur PCM ou la valeur de modulation de code d'impulsion la plus élevée d'un fichier audio. Fondamentalement, la normalisation des crêtes traite l'audio sur la base de la limite supérieure d'un système audio numérique, ce qui équivaut généralement à normaliser la crête maximale à 0 DB.

L'effet de normalisation par la normalisation des crêtes est strictement basé sur les niveaux de crête, plutôt que sur le volume perçu de la piste.

Normalisation de l'intensité sonore

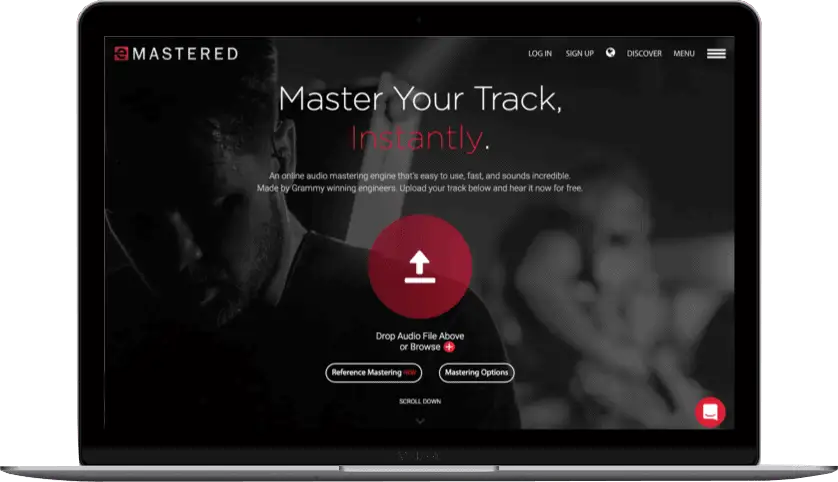

Le processus de normalisation de l'intensité sonore est plus complexe car il prend en compte la perception humaine de l'audition. L'audition humaine tient compte des différents volumes et amplitudes séparément, car l'oreille humaine présente certains défauts subjectifs en matière de perception. Vous pouvez entendre ce traitement appelé détection de volume EBU R 128.

Par exemple, les sons qui sont maintenus au même niveau sonore que les sons qui sont joués de manière transitoire ou brève semblent automatiquement plus forts. Vous pouvez émettre ces sons au même niveau de volume et l'oreille humaine percevra toujours le son soutenu comme plus fort. La normalisation de la sonie doit donc tenir compte de ces décalages perceptifs.

Certains pensent également que la musique plus forte a tendance à sonner mieux. C'est ce qui a donné naissance aux guerres de volume avant l'existence des services de streaming, où les musiciens essayaient de maximiser le volume maximal pour produire une œuvre d'art plus agréable sur le plan sonore. Heureusement, la normalisation audio a mis fin à la guerre du volume sonore, de sorte que vous n'entendez plus constamment des volumes différents lorsque vous passez d'une piste à l'autre.

La normalisation de l'intensité sonore est mesurée en LUF, ce qui est plus fidèle à l'oreille humaine et sert de norme audio dans des applications telles que le cinéma, la télévision, la radio et les services de diffusion en continu. Tout comme la normalisation des crêtes, les 0 dB restent la norme.

La courbe de Fletcher Munson, telle qu'illustrée ci-dessus, peut aider à décrire les écarts pris en compte dans la normalisation de l'intensité sonore par LUFS.

Détection du volume efficace

Si vous n'avez pas l'intention de normaliser les canaux stéréo avec la normalisation du niveau de crête, vous utiliserez probablement la normalisation de l'intensité sonore, mais il convient tout de même de mentionner l'autre méthode de traitement de l'intensité sonore, à savoir la détection du volume RMS.

Le processus de normalisation est similaire à la normalisation de l'intensité sonore de la LUF, mais il utilise les niveaux RMS à la place. La moyenne quadratique ou RMS mesure le volume moyen d'une section ou de la durée totale d'un clip.

Cependant, tout comme la normalisation basée sur le pic le plus élevé, la normalisation RMS ne tient pas compte de l'oreille humaine. C'est pourquoi les ingénieurs de masterisation travaillent généralement avec des unités de volume sonore LUF et des processus de normalisation en tant que norme. Le mastering ne consiste pas seulement à créer des volumes adaptés tout au long d'un projet. Il est également essentiel de prendre du recul et de tenir compte de la dynamique, de la perception humaine et de l'équilibre entre chaque piste.

Normalisation et compression : Quelle est la différence ?

On pense souvent que la normalisation et la compression sont la même chose, mais il s'agit d'une idée fausse. La compression est conçue pour augmenter le volume le plus bas d'une piste et diminuer les crêtes d'une piste, créant ainsi des niveaux de volume plus cohérents. En revanche, la normalisation définit le point de consigne le plus fort comme le plafond de votre piste audio.

À partir de là, une quantité proportionnelle de gain d'écrêtage est appliquée au reste de l'audio, préservant la dynamique (la distance entre les sons les plus forts et les plus faibles), ce qui augmente effectivement le volume perçu en fonction du niveau de crête.

Les inconvénients de la normalisation audio

Il convient de noter que la normalisation audio présente certains inconvénients. La plupart du temps, vous ne normalisez l'audio qu'au cours des dernières étapes du processus de création. En effet, la normalisation amène souvent l'audio à l'amplitude maximale dans un plafond numérique, de sorte que vous n'avez pas beaucoup de pouvoir d'édition après qu'un morceau d'audio a été normalisé.

Vous ne voudriez pas normaliser des pistes audio individuelles qui doivent encore être mixées dans le contexte d'un enregistrement multipiste. Si tous les composants individuels sont déjà normalisés en fonction de votre plafond audio numérique, ils seront certainement coupés lorsqu'ils seront joués ensemble.

La normalisation audio est également destructive par nature. Lorsque vous normalisez l'audio, le traitement numérique est intégré à la piste audio. Par conséquent, la normalisation audio a un temps et un lieu précis. Ce processus est principalement utilisé après que vos fichiers audio ont été traités à leur convenance.

Comment normaliser l'audio

Chaque logiciel d'édition audio a sa propre façon de normaliser l'audio numérique. Nous montrerons comment vous pouvez normaliser l'audio dans Ableton Live, mais tous les logiciels d'édition audio intègrent cette fonctionnalité dans leurs commandes :

1. Consolidez votre piste

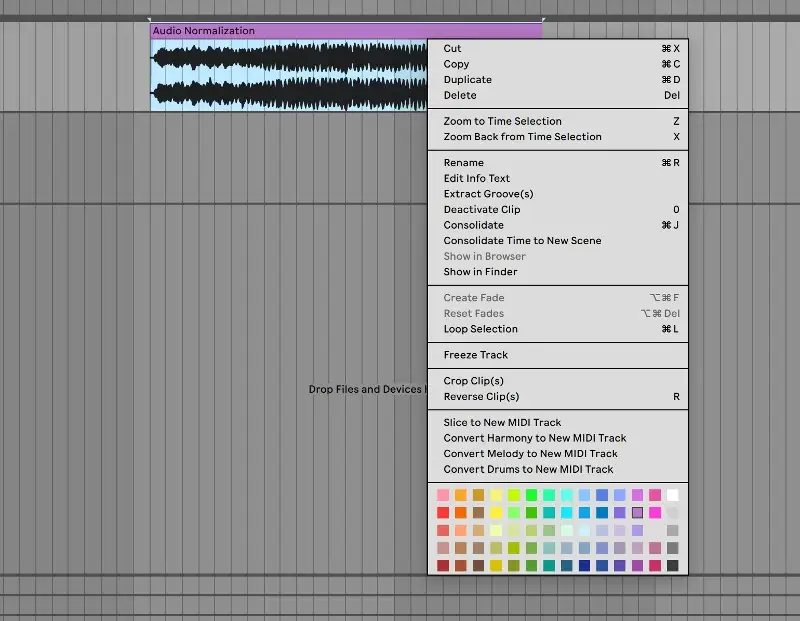

Pour commencer, amenez votre fichier audio sur une piste audio propre. Sélectionnez la piste audio, faites un clic droit et sélectionnez "consolider" dans le menu. Vous pouvez également utiliser le raccourci clavier CTRL/CMND + J pour consolider rapidement une piste en surbrillance.

2. Désactiver la déformation et remettre le gain à 0 dB

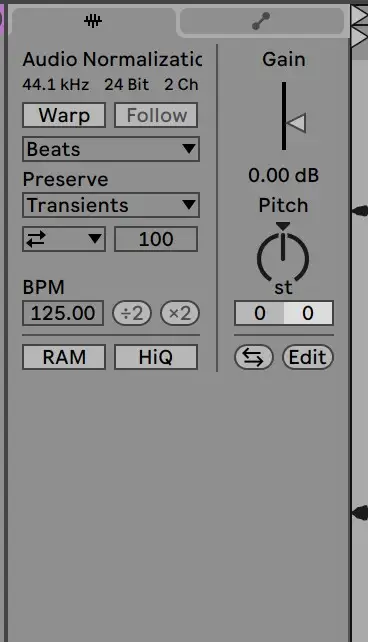

À partir de là, allez dans le clip de l'échantillon pour désactiver la déformation et remettre le gain à 0 DB. Vous pouvez le faire en double-cliquant sur la flèche de gain :

3. Comparaison avec le fichier original

A partir de là, votre clip devrait être normalisé ! Vous pouvez vérifier les niveaux de votre clip par rapport au fichier audio original pour vous assurer qu'il a été traité correctement.

La normalisation audio est une compétence essentielle pour tout producteur. Nous espérons que ce guide vous permettra de comprendre plus facilement comment normaliser vos pistes et l'importance de ce processus.